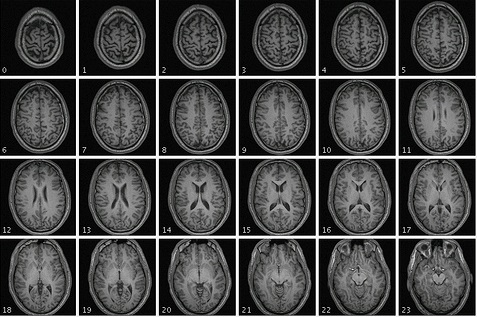

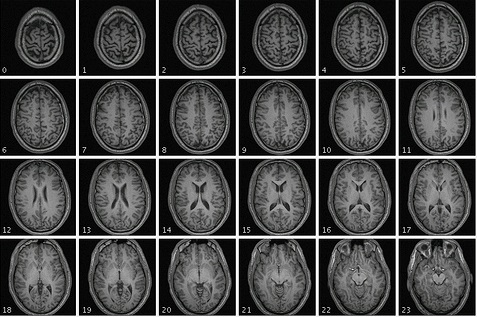

© Dan VogelIRM de cerveau

les plus angoissantes pour les chercheurs : le phénomène que je mets en évidence est-il bien réel, d'autres équipes le retrouveront-elles ou bien n'est-ce qu'une illusion provoquée par mon protocole expérimental ? La question peut sembler étonnante à première vue mais elle est de plus en plus d'actualité dans le domaine du vivant, pour lequel on ne peut obtenir le degré de certitude exigé dans la découverte du boson de Higgs. Il a ainsi été démontré que

de nombreuses études biomédicales, si ce n'est la plupart d'entre elles, étaient... fausses dans le sens où elles décrivaient des effets qui n'existaient probablement pas

et que l'on n'arrivait pas à reproduire. Le même constat a été fait en génétique et en psychologie. Aujourd'hui, c'est au tour des neurosciences de se retrouver sur la sellette suite à une étude américano-britannique

publiée le 10 avril par Nature Reviews Neuroscience.

L'origine du mal est connue. Il s'agit de la fameuse pression mise sur les scientifiques, la loi du "Publie ou péris" (

"Publish or perish" dans la version anglo-saxonne), puisque l'évaluation des chercheurs et les budgets décrochés par leurs laboratoires dépendent notamment du nombre d'articles publiés. Cette course à la référence incite les acteurs de la science à multiplier les études et les expériences avec des protocoles pas toujours rigoureux sur le plan statistique. Le manque de moyens alloués aux laboratoires participe aussi à cette dérive puisque les contraintes budgétaires restreignent la taille des échantillons qui fournissent les données à analyser. Le tout a pour conséquence de réduire la puissance statistique de ces études, c'est-à-dire la probabilité pour qu'elles découvrent un effet et pour que celui-ci soit réel. Avec une puissance statistique de 80 %, qui est une norme correcte, quatre études sur cinq mettront en évidence un phénomène et il y a, à l'inverse, assez peu de chances pour que ce qu'elles trouvent soit un artéfact.