Les questions au sujet des modérateurs de YouTube et du pouvoir qu'ils détiennent ont été soulevées cette semaine après que des experts conservateurs, des défenseurs des armes à feu, des réseaux de conspiration et d'autres voix de droite ont reçu des avertissements communautaires ou ont été exclus de leurs réseaux.

Les créateurs qui sont touchés par les avertissements et suspensions de chaînes, les grèves et les suspensions s'y réfèrent comme à la "purge YouTube", affirmant que YouTube purge tout contenu de droite ou pro-arme à feu. Cette mesure fait suite à la tentative de l'entreprise de mettre un frein au contenu dangereux après la tuerie de Parkland.

Un représentant de YouTube a reconnu que les nouveaux modérateurs, embauchés dans le cadre du plan de l'entreprise visant à embaucher 10 000 personnes pour superviser le contenu et répondre aux drapeaux, ont peut-être été un peu trop zélés.

"Alors que nous nous efforçons d'embaucher rapidement et de renforcer nos équipes d'application de la loi tout au long de l'année 2018, les nouveaux membres pourraient mal appliquer certaines de nos politiques, ce qui entraînerait des retraits par erreur", peut-on lire dans une déclaration de YouTube donnée à Bloomberg.

Les chaînes ont été rétablies et les suspensions ont été supprimées, mais cela a conduit à un nouveau mouvement de la part des voix conservatrices qui s'inquiètent de la censure des modérateurs de YouTube. Sargon d'Akkad, dont le vrai nom est Carl Benjamin, est un YouTuber de droite bien connu qui s'est fait connaître lors de la campagne GamerGate, un mouvement haineux et de harcèlement qui a débuté en 2014. La chaîne YouTube de Benjamin est devenue un sujet de discussion cette semaine lorsqu'il a annoncé que Google l'avait bloqué hors de son compte, disant qu'il était utilisé d'une manière qui violait les règles de Google.

"Sans avertissement, Google a suspendu mon compte, ce qui m'empêche de me connecter à mes comptes YouTube", écrit-il sur Facebook. "Mes chaînes YouTube n'ont eu aucun strike. La purge est là."

Benjamin a obtenu l'accès à son compte un jour plus tard, et dans une nouvelle vidéo, il a déclaré qu'il croyait en une "méthode plutôt draconienne, YouTube sont en train d'appliquer une suspension à mon compte à cause d'un événement qui s'est produit il y a plus d'un an". Benjamin a dit qu'il "ne veut pas pointer du doigt", mais considère le moment du blocage comme suspect.

"Le moment de cette venue au cours de la purge YouTube, dans laquelle des dizaines de personnes de droite et souvent des chaînes traitant d'armes ont été tout simplement bannies, ou des chaînes sur les théories du complot, que ce soit pour ou contre ont été carrément bannies", a dit Benjamin. "Je ne sais pas vraiment quels seront les résultats de tout ça parce que c'est juste une théorie qui fonctionne, donc je ne sais pas si ma chaîne va disparaître ou pas."

La chaîne de Benjamin n'est qu'une des chaînes supposément affectées par la soi-disant purge. Tim Harmsen, qui dirige la populaire chaîne militaire Arms Channel sur YouTube, a posté une vidéo le 24 février, affirmant que sa chaîne avait été strikée parce que trois de ses vidéos sur les armes contenaient du contenu dont les modérateurs disaient qu'il "encourageait les activités illégales ou incitait les utilisateurs à enfreindre les lignes directrices de YouTube".

YouTube essaie de réduire le contenu dangereux depuis un certain temps. Un billet de blog de l'équipe de YouTube publié le 1er août 2017 a décrit les nouvelles directives de modération pour le contenu potentiellement dangereux. L'article est arrivé à peine quelques semaines après que la compagnie eut fait l'objet d'un examen minutieux du contenu extrémiste sur YouTube, qui aurait été pris en compte par l'un des agresseurs impliqués dans l'attentat terroriste du London Bridge en juin 2017.

"Nous allons bientôt appliquer un traitement plus sévère aux vidéos qui ne sont pas illégales mais qui ont été signalées par les utilisateurs comme des violations potentielles de nos politiques sur le discours haineux et l'extrémisme violent", peut-on lire dans l'article. "Si nous découvrons que ces vidéos ne violent pas nos politiques, mais contiennent des contenus religieux ou suprématistes controversés, elles auront certaines fonctionnalités supprimées."Les événements survenus entre août 2017 et aujourd'hui ont amené les créateurs de contenu à déclarer que la société lançait une attaque contre des voix de droite, dont beaucoup étaient considérées comme se contentant de "violations potentielles de nos politiques en matière de discours haineux et d'extrémisme violent".

Beaucoup de ces voix affirment que YouTube rassemble des chaînes politiques de droite et conservatrices avec les vidéos de conspiration qui inondent le site.

Les vidéos conspirationnistes sont un genre en plein essor

YouTube tente actuellement de lutter contre les contenus dangereux et les idéologies haineuses sur sa plateforme.

Après la fusillade de Parkland et les vidéos de conspiration sur YouTube, qui ont attiré l'attention critique de la presse internationale, les modérateurs de YouTube ont semblé débordés. Alors que les conservateurs et les voix de droite y voient une purge, en utilisant les avertissements appliquées à la chaîne Infowars d'Alex Jones comme preuve que YouTube essayait de censurer des gens comme eux, YouTube considère qu'il est exagéré d'essayer de résoudre son problème croissant.

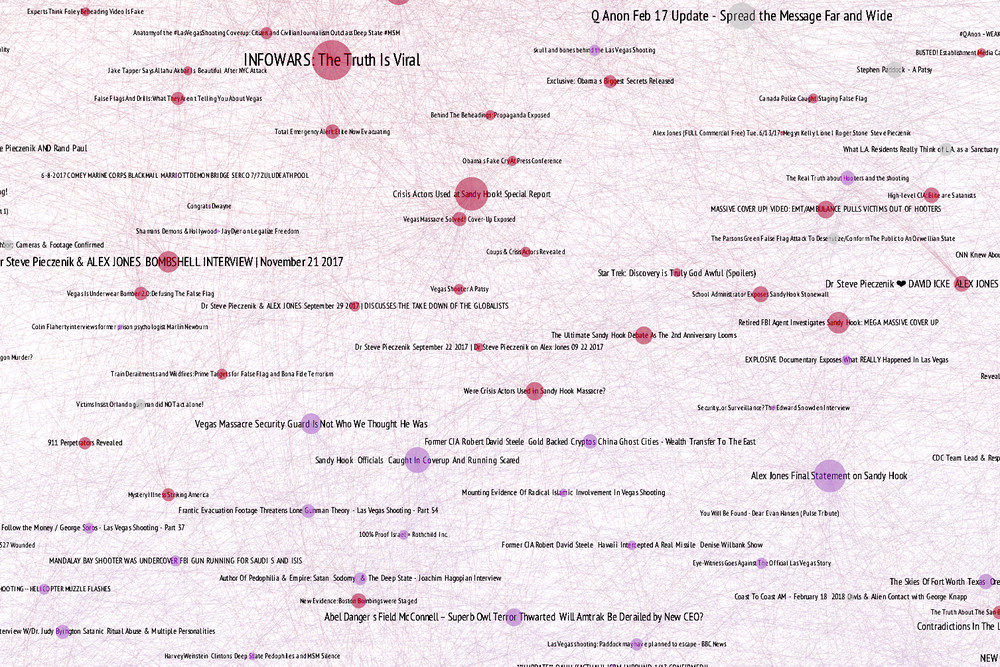

Jonathan Albright, directeur de recherche au Tow Center for Digital Journalism, a compilé des données qui ont montré à quel point les vidéos recommandées et liées à YouTube sont dangereuses et proviennent de différents canaux. M. Albright a découvert qu'en tapant le terme "acteur de crise", une expression utilisée pour attaquer les survivants de la fusillade de Parkland qui défendaient le contrôle des armes à feu en Amérique, les résultats qui découlaient de la chaîne d'Alex Jones et du contenu connexe ont mené à des vidéos troublantes et haineuses. Il y a eu croisement entre les vidéos de conspiration sur la plate-forme et le contenu de Jones, ce qui aurait pu conduire les modérateurs à s'efforcer de réprimer les contenus préjudiciables.

"D'après mon expérience, dans l'espace de la désinformation, toutes les routes semblent éventuellement mener à YouTube", a déclaré M. Albright. "Cela exacerbe tous les autres problèmes, parce qu'il permet aux créateurs de contenu de monétiser du matériel potentiellement préjudiciable tout en bénéficiant de la visibilité offerte par ce qui est sans doute le meilleur système de recommandation au monde."

"Bien qu'ils aient pas besoin de censurer carrément, il faut mettre en place des politiques qui incluent des filtres facultatifs et des modérateurs humains pour aider à protéger les enfants et les autres personnes vulnérables de ce matériel."

Commentaire : Il faut protéger la morale, les bonnes mœurs... et censurer. Bla bla bla. Dans quel siècle vivons-nous pour en être encore rendus à écouter ce genre de discours ?

YouTube essaie de travailler sur son algorithme, en changeant la façon dont les recommandations sont utilisées et quelles vidéos sont diffusées aux gens. Malheureusement, cela signifie que les chaînes sont touchées lorsque les modérateurs tentent de s'attaquer au contenu qui, selon eux, peut encourager les activités dangereuses.

Anthony Fantano, un YouTuber populaire qui commente souvent les tendances de YouTube, a dit à Polygon qu'il appartient à YouTube de déterminer ce qu'est une vidéo ou une chaîne de conspiration et ce qu'est un commentaire politique. Le fait de pouvoir déchiffrer entre les deux, a dit M. Fantano, permet d'avoir un contenu plus sûr sur la plate-forme tout en permettant la liberté d'expression.

Commentaire : Il faudrait aussi définir ce qu'est une conspiration et un commentaire politique. Parfois le commentaire politique est conspirationniste. Parfois les chaînes de "conspiration" font d'excellents commentaires politiques.

"YouTube n'a pas trouvé un moyen de s'assurer que leurs algorithmes ne devraient pas promouvoir ces vidéos complotistes", a déclaré Fantano. "Ces vidéos ne devraient pas se retrouver en première page ou sur la page des tendances. Ces vidéos ne devraient pas être les tendances ou la première chose que vous voyez sur la plate-forme lorsque vous recherchez des informations sur les fusillades de l'école."Avec l'attention accordée à YouTube plus que jamais auparavant et l'entreprise qui tente d'apaiser les créateurs et les annonceurs, la question est de savoir ce qu'il faut faire maintenant. Comment les commentateurs politiques et les défenseurs des armes à feu coexistent-ils ?

"Là où YouTube échoue vraiment sur ce front... vous savez, je suis un puriste de la liberté d'expression, je crois que si quelqu'un a quelque chose à dire, et que YouTube s'accroche à ces idéaux de liberté d'expression, alors ils devraient le permettre. Mais si ce n'est pas le cas, ils devraient le dire."

Ils ne le font probablement pas

Robert Kyncl, directeur commercial de YouTube, qui supervise les créateurs sur la plateforme, a déclaré il y a quelques semaines au créateur de contenu populaire Casey Neistat que YouTube fonctionnait sous quatre idéologies : liberté d'expression, liberté d'information, liberté d'opportunité et liberté d'appartenance.

"Les gens qui créent des communautés sur YouTube avec des gens où ils peuvent partager un peu plus", a cité Kyncl comme un aspect important des croyances de YouTube dans l'interview.

Tandis que YouTube se bat pour définir le type de contenu qu'il autorise sur sa plate-forme et le type de créateurs qu'il ne permet pas, il exacerbe un schisme croissant entre une base d'utilisateurs qui, en partie, considère YouTube comme un espace public où presque tout le monde peut télécharger des vidéos et l'entreprise elle-même, désireuse de régner dans les embarras des annonceurs, du discours haineux à la désinformation. Il est facile de s'entendre sur le fait que les discours haineux, et ceux qui prônent des idéologies haineuses sous prétexte de discours politique, ne devraient pas être autorisés à figurer sur le programme, mais pour d'autres, qui prétendent qu'ils sont forcés de quitter le programme à cause du contenu qu'ils considèrent comme bénin, la "purge" est quelque chose qui les inquiète.

Fantano a dit que ce n'est qu'une question de temps avant que les gens commencent à quitter YouTube et de trouver des foyers sur les plates-formes et les sites Web qui hébergent le contenu avec peu de surveillance. DTube de Steemit, une plateforme vidéo peu modérée, BitChute, et Minds, un site Web conçu pour les personnes qui ont tendance à faire face à des plateformes sociales et vidéo plus populaires, ne sont que quelques exemples de cette mentalité en action.

"Je pense qu'en fin de compte, ce sera un net positif", a dit Fantano. "Ça m'a dérangé personnellement pendant un moment que YouTube... la concurrence, est en quelque sorte devenue stagnante."

Fantano comprend qu'en tant que société privée, les dirigeants de YouTube sont autorisés à faire ce qu'ils veulent. Face aux inquiétudes suscitées par les purges, aux problèmes croissants de conspiration et à un sentiment général de malaise parmi sa base de créateurs, Fantano demande à YouTube de simplement parler aux gens du type de plate-forme qu'il veut être.

"YouTube est libre d'accueillir ou non le type de contenu qu'ils veulent sur la plateforme, j'aimerais juste qu'ils soient un peu plus clairs à ce sujet. Je pense que s'ils ne veulent pas avoir de contenu basé sur la conspiration sur la plateforme parce qu'ils ont l'impression qu'il y a un dilemme moral là-dedans avec une plate-forme qui répand cette désinformation en étant capable de l'héberger, j'espère qu'ils viendront vers les créateurs et le diront ouvertement.

J'aimerais que YouTube soit un peu plus transparent, même à l'avenir, avec ce qu'ils font et ne veulent pas sur le site."

[Lien]

[Lien]

Et big brother

[Lien]