Commentaire: Un article placé dans la section « Ne paniquez pas ! Rigolez ! », non pour faire preuve d'une espèce de nihilisme grinçant, désabusé, parfois tentant mais tout à fait contre-productif, mais bien plutôt pour nous aider à relativiser, qui sait, ce qui peut parfois sembler nous submerger quand nous faisons le compte du nombre invraisemblable de difficultés, d'épreuves et de contraintes auxquelles doit faire face l'humanité. A l'aune de notre propre disparition, les choses reprennent en général leur juste place : si nous savons qu'il n'y a pas grand-chose à sauver d'un monde qui rend le monde tel qu'il est, la conscience que l'on place dans les choses les plus insignifiantes de la vie quotidienne nous rend peut-être plus apte à surmonter ce qui nous semble insurmontable.

Don Juan à Castaneda :

« Ce Chemin possède-t-il un cœur ? S'il en a un, le chemin est bon. Sinon, à quoi bon ? Les chemins conduisent nulle part, mais celui-ci a du cœur, et celui-là n'en a pas. Sur celui-ci, le voyage sera joyeux, et tout au long du voyage, vous ne formerez qu'un. L'autre vous fera maudire l'existence. Le premier vous rendra fort, l'autre faible. »

Un petit groupe d'universitaires comprenant des mathématiciens, des biologistes, des informaticiens, des juristes ou encore des philosophes a constitué à l'Université de Cambridge une équipe très spéciale dont la mission est d'étudier les risques existentiels, en d'autres termes les menaces auxquelles l'humanité peut être confrontée dans un futur indéterminé. Tous les aspects de la politique, des sciences et des technologies ont été abordés par ce centre pour l'étude des risques existentiels (CSER, acronyme de Center for the Study of Existential Risk). Selon les évaluations qui ressortent de leurs travaux il est urgent de sensibiliser l'opinion au sujet de ces risques qui ne sont pas ceux que l'on croit communément.

# 1 Intelligence artificielle

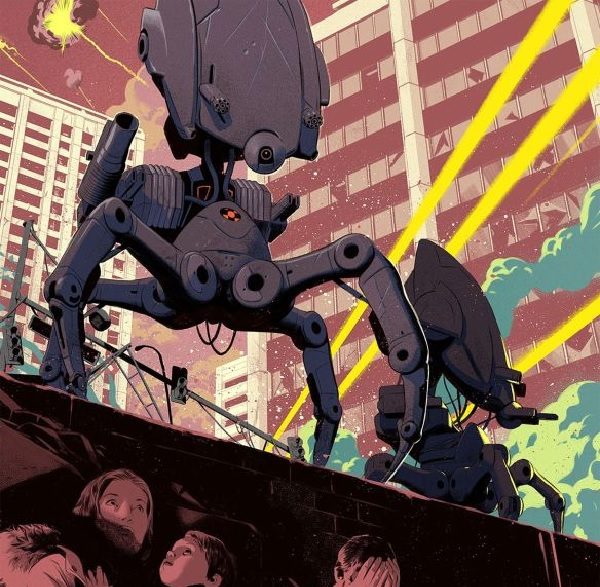

Le plus grand risque que court l'humanité serait l'intelligence artificielle prise globalement, non pas seulement des super-ordinateurs dans lesquels des algorithmes complexes influencent nos choix, ce qui est déjà le cas avec Google, ayant pour conséquence un appauvrissement de notre liberté de décision, mais également les machines considérées globalement en particulier les robots. Le risque serait, si aucun contrôle n'est organisé à l'échelle planétaire dès aujourd'hui, une prise en otage de l'ensemble de l'humanité. Les machines décideraient entièrement pour nous. Ce n'est pas de la science-fiction du genre « Terminator » mais bien une réalité qui nous concerne tous et le CSER classe l'intelligence artificielle comme la plus grande menace pour l'humanité dès 2075.

Commentaire: Pourquoi 2075, on se le demande. Au vu des progrès constant de l'informatique et de la robotique, on se dit qu'une "étincelle" suffirait à déclencher, à n'importe quel moment, la "singularité technologique" que l'on craint :

# 2 Risque biologique

Le développement inimaginable il y a encore 30 années de la biologie moderne constitue le second plus grand risque pour l'humanité. Les outils modernes de la biologie moléculaire ont ouvert la boite de Pandore. Les biologistes sont capables, notamment à l'aide de l'outil CRISPR-cas9 de créer des virus nouveaux et de modifier des bactéries anodines pour les transformer en facteurs pouvant provoquer une pandémie totalement incontrôlable qui décimera en quelques années l'ensemble de l'humanité. Ce que craint le CSER est que la banalisation des outils de la biologie moléculaire permette à n'importe quel biologiste un tant soit peu expérimenté de procéder dans son garage à ce genre d'approche sans qu'aucun contrôle puisse être mis en place. Le risque biologique existe déjà et il est classé comme très élevé.

Commentaire: Une pandémie incontrôlable serait presque un moindre mal en comparaison des possibilités de modifications génétiques offert par le cauchemardesque CRISPR. Remaniement sans limites de l'ADN humain :

- Première mondiale : les modifications génétiques artificielles chez l'humain

- Un peu de génétique de destruction massive ?

- Révolution en génétique : le CRISPR-Cas9 ou la nouvelle baguette magique des apprentis-sorciers

- Les humains synthétiques, pour bientôt ?

- Où l'on commence à modifier le génome humain

# 3 Les armes autonomes

Ce risque, aussi, existe déjà : la perte de contrôle d'armements intelligents. Juste un exemple pour situer ce risque. L'armée sud-coréenne surveille sa frontière la séparant de la Corée du Nord à l'aide de robots construits par la firme Samsung. Ces machines sont capables de reconnaître un individu tentant de traverser cette frontière et de l'abattre sans l'autorisation d'une hiérarchie inexistante devenue inutile. Le CSER a imaginé les pires scenarii. Il suffirait de quelques camions remplis de robots intelligents pour détruire une ville entière. À l'extrême limite il deviendrait impossible d'identifier l'ennemi. Durant la guerre froide la stratégie était d'empiler des bombes nucléaires pour dissuader l'ennemi d'attaquer. Aujourd'hui il est tout à fait réaliste d'imaginer des armées sans combattants, des machines feront le travail en lieu et place des combattants traditionnels. Ce risque de guerre robotisée à l'aide de drones intelligents est déjà présent et devra faire l'objet de traités internationaux pour en limiter la portée. C'est l'une des retombées majeures du risque # 1.

Commentaire: Cela fait déjà quelques années que le gouvernement américain, par exemple, pratique l'assassinat ciblé à l'aide de ses drones. De l'assassinat au massacre, il n'y a qu'un pas, vite franchi par les psychopathes qui sévissent dans les milieux politiques et militaires.

# 4 Conflit nucléaire

Le CSER considère que le risque de conflit nucléaire entre les deux puissances (USA et Russie) possédant à elles deux plus de 90 % des armes nucléaires existant dans le monde serait surtout la conséquence d'une fausse alerte. Statistiquement et selon les leçons du passé la probabilité d'une fausse alerte initiant par erreur un conflit nucléaire conduisant à la disparition de l'humanité est de une fausse alerte tous les 14 ans. Il est donc loin d'être nul et l'équipe de Cambridge préconise une remise en question globale du risque de fausse alerte de la part des autorités russes et nord-américaines mais aussi chinoises, pakistanaises et indiennes. Sachant qu'un conflit nucléaire généralisé conduirait à une destruction totale de l'humanité le CSER classe pourtant ce risque comme peu élevé.

Commentaire: Peut-être parce que nous vivons avec depuis longtemps ? Toujours est-il que :

# 5 Risque climatique

Pour le CSER le risque du changement climatique d'origine humaine sur l'organisation de la société dans son ensemble doit être pris en considération mais il existe trop d'incertitudes pour évaluer l'ampleur de ce réchauffement ainsi que son impact sur l'humanité. Si ce risque existe déjà il est classé comme peu préoccupant par cet organisme de prospective.

Commentaire: Et ils ont bien raison, les bougres, puisque "le risque du changement climatique d'origine humaine" est une fable. Ce qui est tout à fait possible par contre, c'est ça :

# 6 Impact d'un astéroïde

Considéré comme probable au cours des 50 à 100 millions d'années à venir, classé très faible mais potentiellement aussi dévastateur que celui qui provoqua la disparition des dinosaures.

Commentaire: Le risque est sans doute très élevé, bien au contraire. On pourra consulter la rubrique "Feu dans le ciel" pour s'en convaincre et constater que l'espace grouille de comètes et d'astéroïdes en tous genres... Avec, à la clé :

# 7 Invasion d'extra-terrestres

Si la probabilité de formes de vie intelligentes dans l'Univers n'est pas nulle une invasion de la Terre par des extra-terrestres a été considérée par le CSER mais classée imprévisible et extrêmement faible, ouf !

Commentaire: On pourra remanier quelque peu la phrase et en proposer une nouvelle version : "Comme la probabilité de formes de vie intelligentes dans l'Univers est extrêmement élevée, une invasion de la Terre par des extra-terrestres est tout à fait possible, a sans doute déjà eu lieu et/ou est déjà en cours." On pourra donc considérer l'idée suivante : puisque dans notre univers la vie se nourrit de la vie, pour des formes de vie plus évoluées, nous pouvons donc faire figure de proie. S'agissant d'extra-terrestres à l'intelligence et aux moyens technologiques très développés, inutile de s'étonner de ne pas les voir débarquer dans notre jardin, comme nous le ferions dans celui de notre voisin, pour :

- dire que le jardin est maintenant le leur

- aller se servir du thé dans le placard qu'ils considèrent aussi comme le leur

- discuter des dernières distractions médiatiques empêcheuses de réfléchir en rond

- feindre un intérêt quelconque pour la vie spirituelle qui semble nous animer

ou tout simplement pour parler barbecue.

- Des voix dans la tête

- 50 années de recherche sur les extraterrestres

- Canada - Un ex-ministre affirme que les extraterrestres existent

- Yves Sillard : « L'existence de civilisations extraterrestres est hautement probable »

- Des leaders de multinationales ont dit que les soucoupes volantes sont réelles et que les extraterrestres existent

# 8 Manque de nourriture et famines massives

Compte tenu des prévisions de croissance de la population mondiale - 9,6 milliards d'habitants en 2050 - le risque de famine est loin d'être négligeable d'autant plus que l'accroissement des rendements agricoles de près de 70 % depuis la fin des années 60 repose entièrement sur la disponibilité en pétrole pour la production d'engrais et de produits chimiques permettant de combattre les ravageurs. Cette amélioration du rendement des cultures vivrières a probablement atteint son maximum et le risque étudié par le CSER est une attaque virale ou fongique massive de l'une ou l'autre des trois céréales les plus cultivées dans le monde, riz, maïs ou blé qui provoquerait une famine aux conséquences incontrôlables. La recherche et l'amélioration génétique des plantes afin qu'elles soient prémunies contre de tels dangers biologiques paraît nécessaire sinon urgente. Le CSER a évalué la venue de ce risque majeur vers les années 2050.

Commentaire: Le manque de nourriture et les famines qu'elle engendre pourrait être la conséquence de presque tous les scénarios envisagés ci-dessus. Mais histoire d'être un peu plus spécifique :

- La faim, arme politique pour dominer et tuer les plus faibles de cette planète

- L'agriculture - la pire erreur de l'humanité

- Un impact de comète serait à l'origine de la famine de l'an 536 à l'an 540 de l'ère commune

- Le climat devient une question de sécurité mondiale

- Les super-tempêtes de l'apocalypse

# 9 La rumeur des accélérateurs de particules

Un accident dans un accélérateur de particules comme celui du CERN « ferait » apparaître un petit trou noir qui finirait pas avaler tout ce qui l'entoure et au final jusqu'à la Terre entière. Sur le papier ce serait en théorie possible mais la probabilité qu'un tel évènement puisse arriver reste du domaine de la pure spéculation.

Commentaire: On se doute bien malgré tout qu'au CERN, il doit se passer des choses pas très nettes...

# 10 Un tyran planétaire

L'arrivée d'un homme à la tête d'une grande nation qui nierait les évidences scientifiques et technologiques pour accaparer pour lui et ses complices l'ensemble des richesses de la planète, une hypothèse qui semble avoir été abordée par le CSER dans la foulée de l'élection de Donald Trump qui a promis de mettre à plat l'affaire du réchauffement climatique. Comme des dizaines de milliers de chercheurs universitaires vivent de crédits alloués pour conforter l'hypothèse du réchauffement climatique d'origine humaine ils se sentent donc directement concernés et à leurs yeux un homme comme Donald Trump est dangereux car « il nie les évidences scientifiques ».

Commentaire: Bah, pourquoi donc se préoccuper d'un seul homme ? Nous avons à disposition une multitude de psychopathes, authentiques petits tyrans, qui mettent en danger, par leurs actions nuisibles quotidiennes, l'ensemble de l'humanité. Une menace de tout premier plan, donc, sans doute la plus importante :

- Introduction à la psychopathie à l'usage du profane

- Une théorie structurelle du narcissisme et de la psychopathie

- De la démocratie à la pathocratie : l'avènement du psychopathe politique

- Ponérologie : pourquoi l'élite corrompue nous inflige autant de mort, de destruction et de souffrance

- La relève psychopathe

Cette énumération appelle quelques remarques. D'abord le dixième risque me paraît un peu spécieux. Qu'un groupe d'intellectuels considère que Donald Trump représente un danger pour la communauté scientifique parce qu'il doute de la véracité de la théorie du réchauffement climatique d'origine humaine me paraît excessif. J'aurais préféré un classement différent de ces risques en y incluant le risque d'un refroidissement du climat n'en déplaise aux tenants du dogme du réchauffement. La robotique, les machines intelligentes, les drones feront l'objet d'une étude internationale et de la mise en place d'un comité d'éthique ad hoc pour réguler les applications de ces technologies aussi bien que faire se peut de même qu'il existe des comités d'éthique qui se penchent sur l'utilisation des cellules embryonnaires humaines. Il s'agira d'une prise de conscience internationale quels que soient les intérêts industriels ou financiers en jeu. Personnellement je ne pense pas que l'asservissement de l'humanité toute entière par des machines puisse être plausible ni possible à moins que les hommes aient atteint un degré de dégénérescence intellectuelle avancé.

Les deux risques les plus préoccupants me paraissent être une attaque des grandes cultures vivrières par un ou des ravageurs incontrôlables comme c'est déjà le cas pour les frênes, les oliviers et les bananiers. Comme pour le phylloxéra et la vigne, l'ingéniosité humaine trouvera une parade mais un tel évènement laissera des traces douloureuses. Les risques « biologiques » pouvant se matérialiser par des expérimentations réalisées par un fou irresponsable sont également à craindre mais mettre au point un virus hautement pathogène tuera son inventeur avant qu'il ne se disperse dans la nature, un virus nécessite un « réservoir » et un vecteur. Je mettrai donc un gros bémol dans l'évaluation du risque # 2. Restent donc les risques # 5 et 8 qui se rejoignent dans le mesure où le refroidissement du climat annoncé par de nombreux géophysiciens et astrophysiciens aura pour conséquence une famine généralisée et une totale et profonde désorganisation de l'ordre mondial. Si j'étais membre du CSER je classerai ce risque en première urgence car apparaissant en 2025 au plus tard comme l'ont avancé des géophysiciens éminents.

mouahahahhahahha l'IA

arrêtez un peu d'être plus bêtes que vos données que vous nous lancez , comme un sujet !

d'abord l IA ne peut exister que par l'intermédiaire de l'homme qui inscrit ses propres données !

et de plus si vous voyez un des nouveaux personnages robotisés "ressemblants à l'homme ou la femme " qui ne sont que de simples robots ..........

Je pense moi , que si un de ces robots , vous dit , en vous surprenant quelque chose de réfléchit tel l'humain , jusqu'à vous faire croire que ce robot là "peut réfléchir" par lui même demandez vous d'abord :

Si ce n'est pas l'inverse .. c'est à dire un humain qui aurait été totalement robotisé ,sauf son cerveau évidemment !

malgré tout j'ai des humeurs avec mon ordinateur , quand il a chaud ou va mal , mais là je pense ouf pour moi que c'est que je me sens mal car je ne vais pas pouvoir jouer tranquillement aujourd'hui tout simplement et si tout à coup mon ordinateur devient intelligent en espérant que ce soit intéressant, j'espère alors qu'on sera tous les deux d'accord sur les mêmes points (hihi)

il ne faut pas tout confondre , je vois leurs jeux non de créer , un robot intelligent , mais de faire d'un être humain un robot !

faut pas confondre hein... faut penser à ça ^^ -un humain robotisé - / et non un - ordinateur qui penserait - !

d'ailleurs afin d'approfondir les données je ne croit pas que les cellules humaines puissent vivre dans une technique non humaine ! nous pouvons donner le plus d'informations à un ordinateur qui peut ainsi les analyser ,mais l'ordinateur ne fera qu'analyser des données humaines et s'arrêtera là . et si jamais cet ordinateur vous sort quelque chose d'incroyable n'ayez pas peur voyons "c'est juste qu'il a bien et grâce à l'homme analysé des données !

je vois que si un humain donne à un ordinateur de faire loi ! , en tant que policier et droit d'utiliser une arme le pauvre ordinateur tirera sans problème par rapport aux donnés de l'homme

Et faire croire qu' un humain , transformé en robot (gardant son cerveau) serait un vrai robot, et de faire croire par là que tous les robots réfléchissent et de plus va fiche encore la peur à tout le monde ... a se poser des questions et encore médiatiser pendant le temps que tout le monde comprennent s'ils comprennent un jour , médiatiser un tas de papier journaux valant de l'or !

la seule chose qui peut faire qu'un robot réfléchisse c est QUE L HOMME LUI A MIT DES DONNEES CORRESPONDANTES A UNE REFLEXION MALHEUREUSEMENT , DES REFLEXIONS INSCRITES PAS L HOMME ! DE CE PRINCIPE LE ROBOT GERE PAR HITLER POURRA BIEN EVIDEMMENT RETRANSCRIRE TOUTES LES DONNEES !

AINIS CE N EST PAS DE LA REFLEXION D UN ROBOT MAIS BIEN DES DONNEES TRANSCRITES PAR L HOMME SUR L ORDINATEUR

il faudra alors dénoncer le coupable "humain" AINSI QU APPUYER SUR LE BOUTON STOP ET RESET (hihi) ou carrément reformater tout ça ^^ mais la faute à l'humain si sont robot analyse qu'aujourd'hui je décide que je ne ferais pas le café de monsieur ^^

faudra juste se dire que le concepteur de données (humain) c'est bien amusé !